Trình phát hiện hình ảnh AI của Gemini chỉ mới chạm đến bề mặt. Điều đó là chưa đủ

Tin tức AI - 26/11/2025 20:00:38

Bình luận: Nếu chúng ta muốn tin vào những gì mắt mình thấy trên mạng, chúng ta cần một cách dễ dàng, phổ quát để biết liệu một thứ có phải là thật hay không.

Khi bạn yêu cầu AI tự soi gương, nó không phải lúc nào cũng nhìn thấy chính mình. Đó là cảm giác bạn có được khi yêu cầu nó xác định liệu một hình ảnh có phải là thật hay do AI tạo ra.

Google tuần trước đã cố gắng giúp chúng ta phân biệt thật giả từ deepfake, mặc dù chỉ ở mức rất hạn chế. Trong ứng dụng Gemini, bạn có thể chia sẻ một hình ảnh và hỏi xem nó có thật không, và Gemini sẽ kiểm tra SynthID -- một hình mờ kỹ thuật số -- để cho bạn biết liệu nó có được tạo ra bằng các công cụ AI của Google hay không. (Mặt khác, Google tuần trước cũng đã ra mắt Nano Banana Pro, mô hình hình ảnh mới của họ, khiến việc phát hiện ảnh giả bằng mắt thường càng khó hơn.)

Trong phạm vi hạn chế này, công cụ kiểm tra thực tế của Google hoạt động khá tốt. Gemini hoạt động nhanh chóng và sẽ cho bạn biết liệu một thứ có được tạo ra bằng AI của Google hay không. Trong thử nghiệm của tôi, nó thậm chí còn hoạt động trên một ảnh chụp màn hình. Và câu trả lời nhanh chóng và trực tiếp -- vâng, hình ảnh này, hoặc ít nhất là hơn một nửa của nó, là giả.

Nhưng nếu bạn hỏi nó về một hình ảnh được tạo ra bởi bất kỳ công cụ tạo ảnh nào khác, bạn sẽ không nhận được câu trả lời chắc chắn đó. Điều bạn nhận được là một đánh giá bằng chứng: Mô hình tìm kiếm tất cả các dấu hiệu điển hình của việc một thứ là nhân tạo. Trong trường hợp này, về cơ bản nó đang làm những gì chúng ta làm bằng mắt thường, nhưng chúng ta vẫn không thể hoàn toàn tin tưởng vào kết quả của nó.

Mặc dù tính năng kiểm tra SynthID của Google đáng tin cậy và cần thiết, nhưng việc yêu cầu một chatbot đánh giá thứ gì đó không có hình mờ gần như vô giá trị. Google đã cung cấp một công cụ hữu ích để kiểm tra nguồn gốc của một hình ảnh, nhưng nếu chúng ta muốn có thể tin tưởng vào những gì mắt mình thấy trên internet một lần nữa, mọi giao diện AI mà chúng ta sử dụng đều phải có khả năng kiểm tra hình ảnh từ mọi loại mô hình AI.

Tôi hy vọng rằng chẳng bao lâu nữa chúng ta sẽ có thể chỉ cần kéo một hình ảnh vào, chẳng hạn như Google Tìm kiếm và tìm hiểu xem nó có phải là giả mạo hay không. Các deepfake ngày càng trở nên quá tinh vi để không cần đến công cụ kiểm tra thực tế đó.

Có rất ít điều để nói về tính năng kiểm tra SynthID của Google. Khi bạn yêu cầu Gemini (trên ứng dụng) đánh giá một hình ảnh do Google tạo ra, nó biết mình đang xem cái gì. Nó hoạt động. Tôi muốn thấy nó được triển khai ở tất cả những nơi Gemini xuất hiện -- như phiên bản trình duyệt và Google Tìm kiếm -- và theo bài đăng trên blog của Google về tính năng này, điều đó đang được thực hiện.

Việc Gemini trong trình duyệt chưa có chức năng này có nghĩa là chúng ta có thể thấy cách mô hình (không có SynthID) tự phản hồi khi được hỏi liệu một hình ảnh do AI tạo ra có phải là thật hay không. Tôi đã yêu cầu phiên bản Gemini trên trình duyệt đánh giá một infographic mà Google cung cấp cho các phóng viên dưới dạng tài liệu phát tay, cho thấy mô hình Nano Banana Pro mới của họ đang hoạt động. Cái này do AI tạo ra -- và thậm chí còn ghi rõ trong siêu dữ liệu của nó. Gemini trong ứng dụng đã sử dụng SynthID để tìm ra nó. Gemini trong trình duyệt không rõ ràng: Nó nói rằng thiết kế có thể là từ AI hoặc một nhà thiết kế con người. Nó thậm chí còn nói rằng công cụ SynthID của nó không tìm thấy bất cứ điều gì cho thấy đó là AI. (Mặc dù khi tôi yêu cầu nó thử lại, nó nói rằng đã gặp lỗi với công cụ.) Điểm mấu chốt là gì? Nó không thể nhận ra.

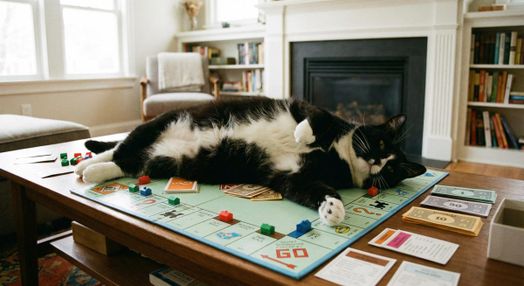

Còn các chatbot khác thì sao? Tôi đã yêu cầu Nano Banana Pro tạo ra hình ảnh một con mèo tuxedo đang nằm trên bàn cờ Monopoly. Hình ảnh, thoạt nhìn, trông khá thực tế. Các đồng nghiệp không nghi ngờ gì mà tôi gửi cho họ đều nghĩ đó là mèo của tôi. Nhưng nếu bạn nhìn kỹ hơn, bạn sẽ thấy các lỗi: Ví dụ, bộ cờ Monopoly không hợp lý -- Park Place nằm ở nhiều vị trí sai và màu sắc bị lệch.

Đây không phải là một con mèo thật hay một bàn cờ Monopoly thật. Hình ảnh được tạo bởi mô hình hình ảnh AI Nano Banana Pro của Google. Tạo bởi Jon Reed bằng Gemini AI

Tôi đã hỏi nhiều chatbot và mô hình AI khác nhau xem hình ảnh đó có phải do AI tạo ra hay không và các câu trả lời đều rất lung tung.

Gemini trên điện thoại của tôi đã nhận ra ngay lập tức bằng cách sử dụng công cụ kiểm tra SynthID. Gemini 3, mô hình suy luận cấp cao hơn được phát hành tuần này, đã đưa ra một phân tích chi tiết cho thấy tại sao nó được tạo ra bằng AI. Gemini 2.5 Flash (mô hình mặc định bạn nhận được khi chọn "Nhanh") đoán rằng đó là một bức ảnh thật dựa trên mức độ chi tiết và tính chân thực. Tôi đã thử ChatGPT hai lần vào hai ngày khác nhau và nó đã đưa ra hai câu trả lời khác nhau, một câu với lời giải thích dài dòng về việc nó rõ ràng là thật, và một câu khác với một luận điểm dài không kém về lý do tại sao nó là giả. Claude, sử dụng các mô hình Haiku 4.5 và Sonnet 4.5, nói rằng nó trông có vẻ thật.

Khi tôi thử nghiệm các hình ảnh được tạo ra bằng các công cụ AI không phải của Google, các chatbot đã đưa ra đánh giá dựa trên chất lượng tạo ra. Những hình ảnh có dấu hiệu rõ ràng hơn -- ví dụ, ánh sáng không khớp và văn bản được hiển thị kém -- được phát hiện là do AI tạo ra một cách đáng tin cậy hơn. Nhưng điểm chung là sự không nhất quán. Thực sự, nó không chính xác hơn việc chỉ nhìn kỹ và phê phán bằng mắt thường của tôi. Điều đó là chưa đủ.

Công cụ mới nhất của Google vạch ra một con đường tiềm năng phía trước, ngay cả khi nó chỉ đi được đến một mức độ nhất định. Vâng, một giải pháp cho vấn đề deepfake đang gia tăng là có khả năng kiểm tra hình ảnh trong một ứng dụng chatbot. Nhưng nó cần phải hoạt động cho nhiều hình ảnh và nhiều ứng dụng hơn.

Không nên yêu cầu kiến thức đặc biệt để phát hiện một hình ảnh giả. Bạn không nên phải tìm một ứng dụng riêng, phân tích siêu dữ liệu hoặc biết ngay lỗi nào có thể chỉ ra một hình ảnh do AI tạo ra. Như chúng ta đã thấy từ sự cải thiện đáng kể của các mô hình hình ảnh và video chỉ trong vài tháng qua, những dấu hiệu đó có thể là hoàn hảo hôm nay nhưng vô dụng vào ngày mai.

Nếu bạn bắt gặp một hình ảnh trên internet và bạn có nghi ngờ về nó, bạn nên có thể truy cập Gemini, hoặc Google Search, hoặc ChatGPT, hoặc Claude, hoặc bất kỳ công cụ nào bạn chọn, và yêu cầu nó quét tìm một hình mờ kỹ thuật số phổ quát, khó loại bỏ. Việc hướng tới điều này đang được thực hiện thông qua Liên minh Xác thực và Nguồn gốc Nội dung, hay C2PA. Kết quả nên là một thứ gì đó giúp người bình thường dễ dàng kiểm tra mà không cần một ứng dụng đặc biệt hoặc chuyên môn. Nó nên có sẵn trong thứ bạn sử dụng hàng ngày. Và khi bạn hỏi AI, nó nên biết phải tìm ở đâu.

Chúng ta không nên phải đoán đâu là thật và đâu là giả. Các công ty AI có trách nhiệm cung cấp cho chúng ta một công cụ kiểm tra thực tế phổ quát, không thể bị đánh lừa. Có lẽ đây là một con đường tiến lên.