Tổng quan về HRM 27M: Mô hình AI nhỏ gọn lấy cảm hứng từ não bộ vượt trội hơn những người khổng lồ

Tin tức AI - 21/08/2025 17:43:44

Tìm hiểu cách thiết kế mô hình AI tối giản của HRM 27M và kiến trúc RNN kép có thể định hình lại tương lai của trí tuệ tổng hợp nhân tạo (AGI)

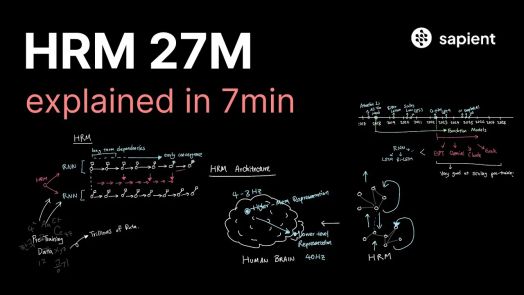

Điều gì sẽ xảy ra nếu tương lai của trí tuệ nhân tạo không phụ thuộc vào kích thước mà là vào sự khéo léo? Trong một thế giới bị thống trị bởi các mô hình transformer khổng lồ với hàng trăm tỷ tham số, mô hình AI HRM 27M là một sự mâu thuẫn táo bạo. Chỉ với 27 triệu tham số—một phần nhỏ so với quy mô của các đối thủ cạnh tranh, HRM thách thức giả định rằng lớn hơn luôn tốt hơn. Được phát triển bởi Sapion Research Lab, mô hình mới này sử dụng một kiến trúc mạng thần kinh hồi quy kép (RNN) lấy cảm hứng từ não người, mở khóa các khả năng đáng ngạc nhiên trong suy luận và giải quyết vấn đề mà không cần dựa vào tiền huấn luyện. Liệu cách tiếp cận tối giản này có thể định nghĩa lại con đường dẫn đến trí tuệ tổng hợp nhân tạo (AGI)?

Caleb Writes Code khám phá cách thiết kế sáng tạo của HRM phá vỡ các chuẩn mực phát triển AI, mang đến một góc nhìn mới mẻ về ý nghĩa của việc xây dựng hệ thống thông minh. Từ kiến trúc lấy cảm hứng từ não bộ đến việc loại bỏ tiền huấn luyện, HRM đặt ra những câu hỏi sâu sắc về hiệu quả, khả năng mở rộng và tương lai của nghiên cứu AGI. Bạn sẽ khám phá cách mô hình nhỏ gọn này đạt được kết quả vượt xa kích thước của nó, tại sao nó thách thức sự thống trị của các hệ thống dựa trên transformer và ý nghĩa của nó đối với tương lai đổi mới AI. Đến cuối cùng, bạn có thể thấy mình đang suy nghĩ lại về nền tảng của trí thông minh, cả nhân tạo và con người.

TL;DR Những điểm chính:

Thiết kế của HRM đối lập hoàn toàn với xu hướng mở rộng các mô hình dựa trên transformer đang thịnh hành. Trong khi các transformer hàng đầu như GPT-4 và Gemini dựa vào hàng trăm tỷ hoặc thậm chí hàng nghìn tỷ tham số, HRM đạt được kết quả đáng kể chỉ với 27 triệu tham số. Ví dụ, nó đạt 32% trên chuẩn ARC AGI 1 và 2% trên ARC AGI 2, những thành tựu đặc biệt đáng chú ý với kích thước nhỏ gọn và không cần tiền huấn luyện. Cách tiếp cận tối giản này nhấn mạnh tiềm năng của các mô hình nhỏ, hiệu quả trong việc thúc đẩy đổi mới nghiên cứu AGI. Bằng cách tập trung vào hiệu quả thay vì sức mạnh tính toán thô, HRM thách thức giả định rằng các mô hình lớn hơn vốn dĩ tốt hơn.

Các mô hình AI truyền thống phụ thuộc rất nhiều vào tiền huấn luyện, thường xử lý hàng nghìn tỷ token từ các tập dữ liệu khổng lồ để phát triển khả năng của chúng. Tuy nhiên, HRM hoạt động mà không cần tiền huấn luyện hoặc học chuyển giao, đánh dấu một sự khác biệt đáng kể so với mô hình này. Thay vào đó, nó nhấn mạnh suy luận lặp đi lặp lại và giải quyết vấn đề, chứng minh rằng trí thông minh có thể xuất hiện mà không cần tiếp xúc dữ liệu rộng rãi. Cách tiếp cận này cho thấy các hệ thống AI trong tương lai có thể được thiết kế và huấn luyện hiệu quả hơn, giảm nhu cầu về tài nguyên tính toán lớn. Bằng cách chứng minh rằng tiền huấn luyện không phải là một yêu cầu tuyệt đối để đạt được kết quả có ý nghĩa, HRM mở ra cánh cửa cho các phương pháp thay thế để phát triển hệ thống AI.

Cốt lõi của sự đổi mới của HRM nằm ở hệ thống vòng lặp hồi quy kép của nó, được mô phỏng theo các mô hình dao động của não người, đặc biệt là sóng theta và gamma. Kiến trúc này bắt chước sự tương tác giữa các quá trình nhận thức nhanh, cấp thấp và suy luận trừu tượng, chậm hơn, cho phép mô hình tham gia vào các chu kỳ phân tích lặp đi lặp lại. Hệ thống vòng lặp kép không chỉ tăng cường khả năng giải quyết vấn đề mà còn giải quyết các thách thức lâu đời trong RNN, chẳng hạn như hội tụ sớm và khó duy trì các phụ thuộc dài hạn. Bằng cách lấy cảm hứng từ não người, HRM giới thiệu một cách tiếp cận mới đối với kiến trúc AI ưu tiên các quá trình nhận thức hơn quy mô tính toán tuyệt đối.

Các mô hình Transformer đã thống trị nghiên cứu AI nhờ khả năng mở rộng và khả năng tổng quát hóa trên nhiều tác vụ khác nhau. Tuy nhiên, chúng thường gặp khó khăn với các tác vụ đòi hỏi suy luận sâu và hiểu biết theo ngữ cảnh. Thành công của HRM làm nổi bật tiềm năng chưa được khai thác của các kiến trúc dựa trên RNN để giải quyết những hạn chế này. Bằng cách ưu tiên suy luận và giải quyết vấn đề lặp đi lặp lại hơn khả năng mở rộng mạnh mẽ, HRM đưa ra một giải pháp thay thế hấp dẫn cho cách tiếp cận lấy transformer làm trung tâm. Sự thay đổi trọng tâm này có thể dẫn đến việc phát triển các hệ thống AI không chỉ hiệu quả hơn mà còn phù hợp hơn với các quá trình nhận thức giống con người.

Mặc dù đạt được nhiều thành tựu, cách tiếp cận của HRM không phải không có thách thức. Các RNN trong lịch sử đã phải đối mặt với khó khăn trong việc duy trì các phụ thuộc dài hạn, và bản chất lặp đi lặp lại của chúng có thể dẫn đến sự kém hiệu quả trong tính toán. Ngoài ra, việc không có tiền huấn luyện, mặc dù có lợi ở một số khía cạnh, nhưng lại hạn chế khả năng tổng quát hóa của mô hình trên nhiều tác vụ khác nhau. Giải quyết những thách thức này sẽ rất cần thiết để thúc đẩy các kiến trúc dựa trên RNN và đảm bảo tính khả thi của chúng trong nghiên cứu AGI. Các phát triển trong tương lai có thể tập trung vào nâng cao hiệu quả của các quá trình lặp đi lặp lại và cải thiện khả năng của mô hình để xử lý các tác vụ đa dạng và phức tạp.

Thành công của HRM báo hiệu một sự thay đổi tiềm năng trong các ưu tiên nghiên cứu AGI. Thay vì chỉ tập trung vào việc mở rộng quy mô các mô hình transformer, các nhà nghiên cứu có thể ngày càng khám phá các kiến trúc thay thế lấy cảm hứng từ nhận thức con người. HRM chứng minh rằng các mô hình nhỏ hơn, chuyên biệt hơn có thể đạt được tiến bộ đáng kể trong AGI bằng cách nhấn mạnh các cơ chế suy luận và học hỏi hơn là sức mạnh tính toán. Sự thay đổi này có thể mở đường cho việc phát triển các hệ thống AI không chỉ hiệu quả hơn mà còn có khả năng suy luận và thích ứng giống con người. Bằng cách thách thức các phương pháp tiếp cận thông thường, HRM khuyến khích một sự khám phá rộng lớn hơn về những gì có thể đạt được trong phát triển AGI.