Cuộc đua chẩn đoán y tế bằng AI gia tăng khi OpenAI, Google và Anthropic tung ra các công cụ y tế cạnh tranh

Tin tức AI - 15/01/2026 14:00:00

OpenAI, Google và Anthropic đã ra mắt các công cụ chẩn đoán AI y tế trong vòng bảy ngày, nhưng chưa có công cụ nào được cấp phép sử dụng lâm sàng bất chấp những tuyên bố về chuyển đổi chăm sóc sức khỏe.

OpenAI, Google và Anthropic đã công bố các khả năng AI y tế chuyên dụng chỉ cách nhau vài ngày trong tháng này, một sự dồn dập cho thấy áp lực cạnh tranh thay vì sự trùng hợp ngẫu nhiên. Tuy nhiên, chưa có bản phát hành nào được cấp phép dưới dạng thiết bị y tế, được phê duyệt để sử dụng lâm sàng hoặc có sẵn để chẩn đoán trực tiếp cho bệnh nhân — bất chấp ngôn ngữ tiếp thị nhấn mạnh vào việc chuyển đổi chăm sóc sức khỏe.

OpenAI đã giới thiệu ChatGPT Health vào ngày 7 tháng 1, cho phép người dùng tại Hoa Kỳ kết nối hồ sơ y tế thông qua quan hệ đối tác với b.well, Apple Health, Function và MyFitnessPal. Google đã phát hành MedGemma 1.5 vào ngày 13 tháng 1, mở rộng mô hình AI y tế mở của mình để diễn giải các bản quét CT và MRI ba chiều cùng với các hình ảnh mô bệnh học toàn slide.

Anthropic đã tiếp nối vào ngày 11 tháng 1 với Claude for Healthcare, cung cấp các bộ kết nối tuân thủ HIPAA tới cơ sở dữ liệu bảo hiểm CMS, hệ thống mã hóa ICD-10 và Sổ đăng ký Định danh Nhà cung cấp Quốc gia (National Provider Identifier Registry).

Cả ba công ty đều đang nhắm mục tiêu vào cùng một điểm yếu trong quy trình làm việc — đánh giá cấp phép trước (prior authorisation), xử lý yêu cầu bảo hiểm, tài liệu lâm sàng — với các phương pháp kỹ thuật tương tự nhưng chiến lược tiếp cận thị trường khác nhau.

Sự tương đồng về cấu trúc là rất đáng chú ý. Mỗi hệ thống đều sử dụng các mô hình ngôn ngữ lớn đa phương thức được tinh chỉnh dựa trên tài liệu y khoa và bộ dữ liệu lâm sàng. Mỗi hệ thống đều nhấn mạnh vào việc bảo vệ quyền riêng tư và các tuyên bố từ chối trách nhiệm về quy định. Mỗi hệ thống đều định vị bản thân là hỗ trợ chứ không phải thay thế phán đoán lâm sàng.

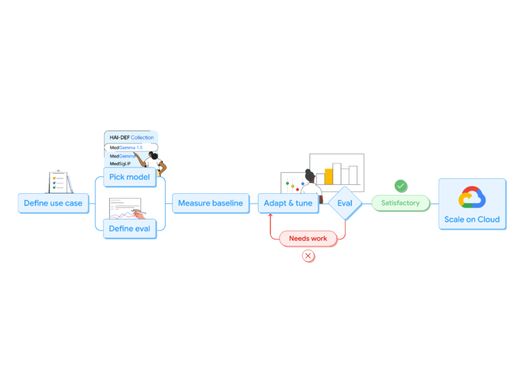

Sự khác biệt nằm ở mô hình triển khai và truy cập. ChatGPT Health của OpenAI hoạt động như một dịch vụ hướng đến người tiêu dùng với danh sách chờ cho những người đăng ký ChatGPT Free, Plus và Pro bên ngoài Khu vực Kinh tế Châu Âu (EEA), Thụy Sĩ và Vương quốc Anh. MedGemma 1.5 của Google được phát hành dưới dạng một mô hình mở thông qua chương trình Health AI Developer Foundations, có sẵn để tải xuống qua Hugging Face hoặc triển khai thông qua Vertex AI của Google Cloud.

Claude for Healthcare của Anthropic tích hợp vào các quy trình làm việc hiện có của doanh nghiệp thông qua Claude for Enterprise, nhắm mục tiêu vào các khách hàng tổ chức thay vì người tiêu dùng cá nhân. Định vị quy định là nhất quán ở cả ba bên.

OpenAI tuyên bố rõ ràng rằng Health “không nhằm mục đích chẩn đoán hoặc điều trị.” Google định vị MedGemma là “điểm khởi đầu để các nhà phát triển đánh giá và thích ứng với các trường hợp sử dụng y tế của họ.” Anthropic nhấn mạnh rằng các kết quả đầu ra “không nhằm mục đích cung cấp thông tin trực tiếp cho chẩn đoán lâm sàng, quyết định quản lý bệnh nhân, khuyến nghị điều trị hoặc bất kỳ ứng dụng thực hành lâm sàng trực tiếp nào khác.”

Kết quả điểm chuẩn AI y tế đã cải thiện đáng kể trên cả ba bản phát hành, mặc dù khoảng cách giữa hiệu suất thử nghiệm và triển khai lâm sàng vẫn còn lớn. Google báo cáo rằng MedGemma 1.5 đã đạt được độ chính xác 92,3% trên MedAgentBench, điểm chuẩn hoàn thành nhiệm vụ tác vụ y tế của Stanford, so với 69,6% của phiên bản cơ sở Sonnet 3.5 trước đó.

Mô hình này đã cải thiện 14 điểm phần trăm về phân loại bệnh qua MRI và 3 điểm phần trăm về các phát hiện CT trong thử nghiệm nội bộ. Claude Opus 4.5 của Anthropic đạt 61,3% trong các bài kiểm tra độ chính xác tính toán y tế MedCalc với tính năng thực thi mã Python được kích hoạt và 92,3% trên MedAgentBench.

Công ty cũng tuyên bố có những cải thiện trong “đánh giá tính trung thực” liên quan đến các ảo giác về sự thật, mặc dù các số liệu cụ thể không được tiết lộ.

OpenAI chưa công bố các so sánh điểm chuẩn cụ thể cho ChatGPT Health, thay vào đó lưu ý rằng “hơn 230 triệu người trên toàn cầu đặt các câu hỏi liên quan đến sức khỏe và thể chất trên ChatGPT mỗi tuần” dựa trên phân tích ẩn danh về các kiểu sử dụng hiện tại.

Các điểm chuẩn này đo lường hiệu suất trên các bộ dữ liệu thử nghiệm được tuyển chọn, không phải kết quả lâm sàng trong thực tế. Các sai sót y tế có thể gây ra hậu quả đe dọa tính mạng, việc chuyển đổi độ chính xác của điểm chuẩn sang tiện ích lâm sàng phức tạp hơn so với các lĩnh vực ứng dụng AI khác.

Khung quy định cho các công cụ AI y tế này vẫn còn mơ hồ. Tại Hoa Kỳ, sự giám sát của FDA phụ thuộc vào mục đích sử dụng. Phần mềm “hỗ trợ hoặc đưa ra các khuyến nghị cho chuyên gia y tế về phòng ngừa, chẩn đoán hoặc điều trị bệnh” có thể yêu cầu xem xét trước khi đưa ra thị trường như một thiết bị y tế. Không có công cụ nào được công bố có sự chấp thuận của FDA.

Các câu hỏi về trách nhiệm pháp lý cũng tương tự như vậy, vẫn chưa được giải quyết. Khi CTO của Banner Health, Mike Reagin, tuyên bố rằng hệ thống y tế đã “bị thu hút bởi sự tập trung của Anthropic vào an toàn AI,” điều này đề cập đến các tiêu chí lựa chọn công nghệ chứ không phải khung trách nhiệm pháp lý.

Nếu một bác sĩ lâm sàng dựa vào phân tích cấp phép trước của Claude và bệnh nhân chịu tổn hại do việc chăm sóc bị trì hoãn, án lệ hiện tại cung cấp rất ít hướng dẫn về việc phân bổ trách nhiệm.

Các phương pháp tiếp cận quy định khác nhau đáng kể giữa các thị trường. Trong khi FDA và Quy định về Thiết bị Y tế của Châu Âu cung cấp các khung thiết lập cho phần mềm như một thiết bị y tế, nhiều cơ quan quản lý APAC vẫn chưa ban hành hướng dẫn cụ thể về các công cụ chẩn đoán AI tạo sinh.

Sự mơ hồ về quy định này ảnh hưởng đến thời gian triển khai ở các thị trường nơi khoảng trống cơ sở hạ tầng y tế có thể đẩy nhanh việc thực hiện — tạo ra sự căng thẳng giữa nhu cầu lâm sàng và sự thận trọng về mặt quy định.

Các triển khai thực tế vẫn được giới hạn cẩn thận. Louise Lind Skov, Giám đốc Số hóa Nội dung của Novo Nordisk, đã mô tả việc sử dụng Claude để “tự động hóa tài liệu và nội dung trong phát triển dược phẩm,” tập trung vào các tài liệu đệ trình quy định hơn là chẩn đoán bệnh nhân.

Cơ quan Quản lý Bảo hiểm Y tế Quốc gia của Đài Loan đã áp dụng MedGemma để trích xuất dữ liệu từ 30.000 báo cáo bệnh lý để phân tích chính sách, không phải để quyết định điều trị.

Mô hình này cho thấy việc áp dụng tại các tổ chức đang tập trung vào các quy trình hành chính nơi sai sót ít gây nguy hiểm tức thời hơn — thanh toán, lập tài liệu, soạn thảo quy trình — thay vì hỗ trợ quyết định lâm sàng trực tiếp, nơi các khả năng của AI y tế sẽ có tác động đáng kể nhất đến kết quả của bệnh nhân.

Các khả năng của AI y tế đang tiến bộ nhanh hơn mức các tổ chức triển khai chúng có thể điều hướng các sự phức tạp về quy định, trách nhiệm pháp lý và tích hợp quy trình làm việc. Công nghệ này đã tồn tại. Gói đăng ký 20 USD hàng tháng cung cấp quyền truy cập vào các công cụ suy luận y tế tinh vi.

Liệu điều đó có chuyển thành việc phân phối chăm sóc sức khỏe được chuyển đổi hay không phụ thuộc vào những câu hỏi mà các thông báo phối hợp này vẫn chưa giải quyết được.