Cuộc chiến bảo mật AI: Liệu Google Cloud có thể phòng thủ trước các mối đe dọa của tương lai?

Tin tức AI - 28/08/2025 18:02:56

Bảo mật AI của Google Cloud đối mặt với thử thách cuối cùng khi kẻ tấn công sử dụng các công cụ tương tự. Mark Johnston thảo luận về Project Zero, Model Armor và thế khó của bên phòng thủ.

Tại văn phòng hiện đại của Google ở Singapore, Block 80, Tầng 3, Mark Johnston đứng trước một nhóm các nhà báo công nghệ vào lúc 1:30 chiều với một lời thừa nhận đáng kinh ngạc: sau năm thập kỷ phát triển an ninh mạng, những người phòng thủ vẫn đang thua cuộc chiến. "Trong 69% các sự cố ở Nhật Bản và Châu Á Thái Bình Dương, các tổ chức đã được các thực thể bên ngoài thông báo về việc họ bị vi phạm," Giám đốc Văn phòng CISO của Google Cloud cho Châu Á Thái Bình Dương tiết lộ, slide trình bày của ông cho thấy một số liệu thống kê đáng báo động – hầu hết các công ty thậm chí không thể phát hiện ra khi nào họ bị xâm phạm.

Những gì diễn ra trong buổi tọa đàm kéo dài một giờ mang tên "An ninh mạng trong kỷ nguyên AI" là một đánh giá chân thực về cách các công nghệ AI của Google Cloud đang cố gắng đảo ngược hàng thập kỷ thất bại trong phòng thủ, ngay cả khi các công cụ trí tuệ nhân tạo tương tự trao cho kẻ tấn công những khả năng chưa từng có.

Cuộc khủng hoảng này không phải mới. Johnston đã truy ngược vấn đề về quan sát của người tiên phong về an ninh mạng James B. Anderson vào năm 1972 rằng "các hệ thống chúng ta sử dụng thực sự không tự bảo vệ được" – một thách thức đã tồn tại dai dẳng bất chấp hàng thập kỷ tiến bộ công nghệ. "Những gì James B Anderson nói vào năm 1972 vẫn còn đúng cho đến ngày nay," Johnston cho biết, nhấn mạnh rằng các vấn đề bảo mật cơ bản vẫn chưa được giải quyết ngay cả khi công nghệ phát triển.

Sự tồn tại dai dẳng của các lỗ hổng cơ bản làm tăng thêm thách thức này. Dữ liệu tình báo mối đe dọa của Google Cloud tiết lộ rằng "hơn 76% các vụ vi phạm bắt nguồn từ những điều cơ bản" – lỗi cấu hình và sự xâm phạm thông tin đăng nhập đã gây khó khăn cho các tổ chức trong nhiều thập kỷ. Johnston đã trích dẫn một ví dụ gần đây: "Tháng trước, một sản phẩm rất phổ biến mà hầu hết các tổ chức đã sử dụng vào một thời điểm nào đó, Microsoft SharePoint, cũng có cái mà chúng tôi gọi là lỗ hổng zero-day… và trong thời gian đó, nó đã bị tấn công và lạm dụng liên tục."

Kevin Curran, thành viên cấp cao của IEEE và giáo sư về an ninh mạng tại Đại học Ulster, mô tả bối cảnh hiện tại là "một cuộc chạy đua vũ trang đầy rủi ro" nơi cả các đội an ninh mạng và các tác nhân đe dọa đều sử dụng các công cụ AI để vượt qua nhau. "Đối với bên phòng thủ, AI là một tài sản quý giá," Curran giải thích trong một ghi chú truyền thông. "Các doanh nghiệp đã triển khai AI tạo sinh và các công cụ tự động hóa khác để phân tích lượng lớn dữ liệu theo thời gian thực và xác định các bất thường."

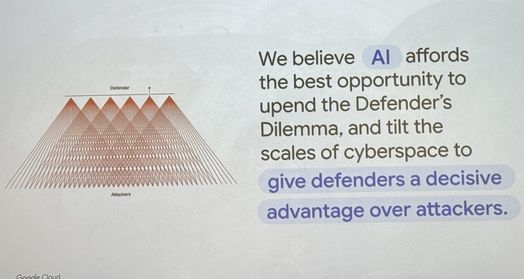

Tuy nhiên, các công nghệ tương tự cũng mang lại lợi ích cho kẻ tấn công. "Đối với các tác nhân đe dọa, AI có thể hợp lý hóa các cuộc tấn công lừa đảo, tự động hóa việc tạo phần mềm độc hại và giúp quét mạng để tìm lỗ hổng," Curran cảnh báo. Bản chất lưỡng dụng của AI tạo ra cái mà Johnston gọi là "Thế khó của bên phòng thủ."

Các sáng kiến AI của Google Cloud nhằm mục đích nghiêng cán cân này về phía bên phòng thủ. Johnston lập luận rằng "AI mang lại cơ hội tốt nhất để lật ngược Thế khó của bên phòng thủ, và nghiêng cán cân không gian mạng để mang lại lợi thế quyết định cho bên phòng thủ so với kẻ tấn công." Cách tiếp cận của công ty tập trung vào những gì họ gọi là "vô số trường hợp sử dụng AI tạo sinh trong phòng thủ," bao gồm phát hiện lỗ hổng, tình báo mối đe dọa, tạo mã an toàn và ứng phó sự cố.

Một trong những ví dụ hấp dẫn nhất về phòng thủ dựa trên AI của Google là sáng kiến "Big Sleep" của Project Zero, sử dụng các mô hình ngôn ngữ lớn để xác định lỗ hổng trong mã thực tế. Johnston đã chia sẻ các số liệu ấn tượng: "Big Sleep đã tìm thấy một lỗ hổng trong một thư viện mã nguồn mở bằng cách sử dụng các công cụ AI tạo sinh – lần đầu tiên chúng tôi tin rằng một lỗ hổng được tìm thấy bởi một dịch vụ AI."

Sự phát triển của chương trình này chứng minh khả năng ngày càng tăng của AI. "Tháng trước, chúng tôi đã thông báo tìm thấy hơn 20 lỗ hổng trong các gói khác nhau," Johnston lưu ý. "Nhưng hôm nay, khi tôi nhìn vào bảng điều khiển Big Sleep, tôi đã tìm thấy 47 lỗ hổng trong tháng 8 đã được tìm thấy bởi giải pháp này."

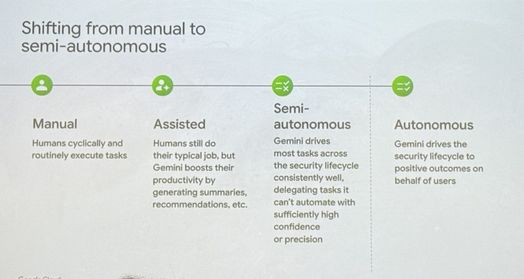

Sự tiến bộ từ phân tích thủ công của con người sang phát hiện có sự hỗ trợ của AI đại diện cho điều mà Johnston mô tả là sự chuyển đổi "từ thủ công sang bán tự động" trong các hoạt động bảo mật, nơi "Gemini điều khiển hầu hết các tác vụ trong vòng đời bảo mật một cách nhất quán, ủy quyền các tác vụ mà nó không thể tự động hóa với độ tin cậy hoặc độ chính xác đủ cao."

Lộ trình của Google Cloud hình dung sự tiến triển qua bốn giai đoạn: Thủ công, Hỗ trợ, Bán tự động và Tự động hóa các hoạt động bảo mật. Trong giai đoạn bán tự động, các hệ thống AI sẽ xử lý các tác vụ thường ngày trong khi chuyển các quyết định phức tạp cho người vận hành. Giai đoạn tự động hóa cuối cùng sẽ chứng kiến AI "thúc đẩy vòng đời bảo mật đạt được kết quả tích cực thay mặt người dùng."

Tuy nhiên, việc tự động hóa này lại mang đến những lỗ hổng mới. Khi được hỏi về rủi ro của việc quá phụ thuộc vào hệ thống AI, Johnston thừa nhận thách thức: "Có khả năng dịch vụ này có thể bị tấn công và thao túng. Hiện tại, khi bạn thấy các công cụ mà những tác nhân này được đưa vào, không có một khuôn khổ thực sự tốt để cấp phép rằng đó là công cụ thực tế chưa bị can thiệp."

Curran cũng chia sẻ mối lo ngại này: "Rủi ro đối với các công ty là đội ngũ bảo mật của họ sẽ trở nên quá phụ thuộc vào AI, có khả năng gạt bỏ phán đoán của con người và khiến hệ thống dễ bị tấn công. Vẫn cần có một 'phi công phụ' là con người và các vai trò cần được xác định rõ ràng."

Cách tiếp cận của Google Cloud bao gồm các biện pháp bảo vệ thực tế để giải quyết một trong những đặc điểm có vấn đề nhất của AI: xu hướng tạo ra các phản hồi không liên quan hoặc không phù hợp. Johnston đã minh họa thách thức này bằng một ví dụ cụ thể về sự không phù hợp ngữ cảnh có thể tạo ra rủi ro kinh doanh.

"Nếu bạn có một cửa hàng bán lẻ, bạn không nên nhận được lời khuyên y tế thay vào đó," Johnston giải thích, mô tả cách các hệ thống AI có thể bất ngờ chuyển sang các lĩnh vực không liên quan. "Đôi khi các công cụ này có thể làm được điều đó." Tính khó đoán này đại diện cho một trách nhiệm pháp lý đáng kể đối với các doanh nghiệp triển khai hệ thống AI hướng đến khách hàng, nơi các phản hồi lạc đề có thể gây nhầm lẫn cho khách hàng, làm tổn hại danh tiếng thương hiệu hoặc thậm chí tạo ra rủi ro pháp lý.

Công nghệ Model Armor của Google giải quyết vấn đề này bằng cách hoạt động như một lớp lọc thông minh. "Việc có các bộ lọc và sử dụng khả năng của chúng tôi để kiểm tra 'sức khỏe' của các phản hồi đó cho phép một tổ chức có được sự tự tin," Johnston lưu ý. Hệ thống này sàng lọc các đầu ra của AI để tìm thông tin nhận dạng cá nhân, lọc nội dung không phù hợp với ngữ cảnh kinh doanh và chặn các phản hồi có thể "lệch thương hiệu" so với trường hợp sử dụng dự kiến của tổ chức.

Công ty cũng giải quyết mối lo ngại ngày càng tăng về việc triển khai AI bóng tối (shadow AI). Các tổ chức đang phát hiện hàng trăm công cụ AI trái phép trong mạng của họ, tạo ra những lỗ hổng bảo mật lớn. Các công nghệ bảo vệ dữ liệu nhạy cảm của Google cố gắng giải quyết vấn đề này bằng cách quét trên nhiều nhà cung cấp đám mây và hệ thống tại chỗ.

Johnston xác định rằng hạn chế ngân sách là thách thức chính mà các CISO khu vực Châu Á Thái Bình Dương đang đối mặt, xảy ra đúng vào thời điểm các tổ chức phải đối mặt với các mối đe dọa mạng leo thang. Nghịch lý này rất rõ ràng: khi số lượng cuộc tấn công tăng lên, các tổ chức lại thiếu nguồn lực để ứng phó thỏa đáng.

"Chúng tôi nhìn vào số liệu thống kê và khách quan mà nói, chúng tôi đang thấy nhiều 'nhiễu' hơn – có thể không phải là siêu tinh vi, nhưng nhiều 'nhiễu' hơn đồng nghĩa với nhiều chi phí hơn, và điều đó tốn kém hơn để xử lý," Johnston nhận xét. Sự gia tăng tần suất tấn công, ngay cả khi các cuộc tấn công riêng lẻ không nhất thiết phải tiên tiến hơn, tạo ra một sự hao hụt tài nguyên mà nhiều tổ chức không thể duy trì.

Áp lực tài chính làm tăng thêm sự phức tạp của bối cảnh bảo mật vốn đã phức tạp. "Họ đang tìm kiếm các đối tác có thể giúp tăng tốc mà không cần phải thuê thêm 10 nhân viên hoặc có ngân sách lớn hơn," Johnston giải thích, mô tả cách các nhà lãnh đạo bảo mật phải đối mặt với áp lực ngày càng tăng để làm nhiều hơn với các nguồn lực hiện có trong khi các mối đe dọa nhân lên.

Mặc dù các khả năng đầy hứa hẹn của AI Google Cloud, một số câu hỏi quan trọng vẫn còn tồn tại. Khi bị chất vấn về việc liệu bên phòng thủ có thực sự chiến thắng trong cuộc chạy đua vũ trang này hay không, Johnston thừa nhận: "Chúng tôi chưa thấy các cuộc tấn công mới lạ sử dụng AI cho đến nay," nhưng lưu ý rằng những kẻ tấn công đang sử dụng AI để mở rộng quy mô các phương pháp tấn công hiện có và tạo ra "một loạt các cơ hội trong một số khía cạnh của cuộc tấn công."

Các tuyên bố về hiệu quả cũng cần được xem xét kỹ lưỡng. Mặc dù Johnston đã trích dẫn sự cải thiện 50% về tốc độ viết báo cáo sự cố, ông thừa nhận rằng độ chính xác vẫn là một thách thức: "Chắc chắn có những điểm không chính xác. Nhưng con người cũng mắc lỗi." Sự thừa nhận này làm nổi bật những hạn chế hiện tại của việc triển khai bảo mật AI.

Ngoài các triển khai AI hiện tại, Google Cloud đã chuẩn bị cho sự thay đổi mô hình tiếp theo. Johnston tiết lộ rằng công ty đã "triển khai mã hóa hậu lượng tử giữa các trung tâm dữ liệu của chúng tôi theo mặc định ở quy mô lớn," nhằm định vị cho các mối đe dọa điện toán lượng tử trong tương lai có thể khiến mã hóa hiện tại trở nên lỗi thời.

Việc tích hợp AI vào an ninh mạng đại diện cho cả cơ hội chưa từng có và rủi ro đáng kể. Trong khi các công nghệ AI của Google Cloud thể hiện khả năng thực sự trong việc phát hiện lỗ hổng, phân tích mối đe dọa và phản ứng tự động, thì các công nghệ tương tự lại trao quyền cho kẻ tấn công với các khả năng nâng cao để trinh sát, kỹ thuật xã hội và lẩn tránh.

Đánh giá của Curran mang lại một góc nhìn cân bằng: "Với tốc độ phát triển nhanh chóng của công nghệ, các tổ chức sẽ phải áp dụng một chính sách an ninh mạng toàn diện và chủ động hơn nếu muốn đi trước kẻ tấn công. Sau tất cả, các cuộc tấn công mạng là vấn đề 'khi nào,' chứ không phải 'liệu có,' và AI sẽ chỉ làm tăng tốc số lượng cơ hội có sẵn cho các tác nhân đe dọa."

Thành công của an ninh mạng được hỗ trợ bởi AI cuối cùng không phụ thuộc vào bản thân công nghệ, mà là vào cách các tổ chức triển khai các công cụ này một cách chu đáo trong khi vẫn duy trì sự giám sát của con người và giải quyết các vấn đề vệ sinh bảo mật cơ bản. Như Johnston đã kết luận, "Chúng ta nên áp dụng những cách tiếp cận ít rủi ro," nhấn mạnh sự cần thiết của việc triển khai có chừng mực thay vì tự động hóa hoàn toàn.

Cuộc cách mạng AI trong an ninh mạng đang diễn ra, nhưng chiến thắng sẽ thuộc về những người có thể cân bằng giữa đổi mới với quản lý rủi ro thận trọng – chứ không phải những người chỉ đơn thuần triển khai các thuật toán tiên tiến nhất.