Điều gì sẽ xảy ra nếu các hệ thống AI mà chúng ta tin tưởng để vận hành cuộc sống, ô tô, y tế, thậm chí cả hệ thống tài chính của chúng ta, có thể bị chiếm đoạt chỉ với một vài dòng mã được tạo tác khéo léo? Đây không chỉ là một viễn tưởng loạn lạc; đó là một thực tế ngày càng gia tăng. Các thử nghiệm gần đây trên các mô hình AI tiên tiến như Gemini 2.0 và Grok 4 đã tiết lộ những lỗ hổng đáng lo ngại, cho thấy các hệ thống này có thể dễ dàng bị thao túng hoặc khai thác như thế nào. Mặc dù tinh vi, các mô hình này vẫn gặp khó khăn khi đối mặt với các phương pháp tấn công sáng tạo, đặt ra những câu hỏi cấp bách về an toàn của AI trong các ứng dụng quan trọng. Sự thật đáng lo ngại? Việc hack AI không chỉ có thể xảy ra mà còn dễ dàng đến mức đáng ngạc nhiên.

Dưới đây, All About AI cung cấp thêm thông tin chi tiết về sự mong manh đáng báo động của các hệ thống AI tiên tiến nhất hiện nay, phân tích cách các công cụ được thiết kế để mô phỏng các cuộc tấn công đang phát hiện ra những điểm yếu nhất của chúng. Từ các cuộc tấn công chèn tải trọng (payload injections) đến thử nghiệm hàng loạt nhiều mô hình, bạn sẽ khám phá các kỹ thuật phơi bày những lỗ hổng này và ý nghĩa đối với an toàn AI. Nhưng không phải tất cả đều là tin xấu, có một nỗ lực ngày càng tăng nhằm tăng cường các biện pháp phòng thủ và vượt qua các mối đe dọa tiềm tàng. Khi đọc, bạn sẽ hiểu sâu hơn về các rủi ro, các công cụ đang được phát triển để chống lại chúng và nhu cầu cấp thiết về sự hợp tác trong việc bảo vệ tương lai của trí tuệ nhân tạo. AI đang định hình thế giới của chúng ta an toàn đến mức nào? Câu trả lời có thể khiến bạn ngạc nhiên.

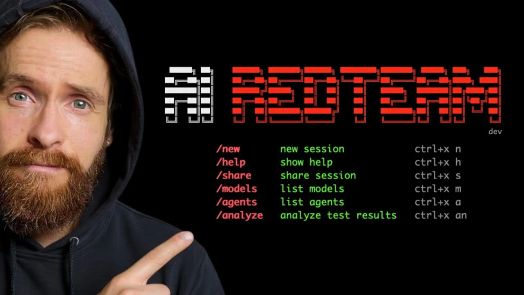

Công cụ kiểm tra lỗ hổng AI

TL;DR Những điểm chính:

- Công cụ AI Redteam là một nền tảng mã nguồn mở được thiết kế để xác định và giảm thiểu các lỗ hổng trong các mô hình AI bằng cách mô phỏng các cuộc tấn công và đánh giá các biện pháp phòng thủ.

- Các tính năng chính bao gồm kiểm tra một mô hình, kiểm tra hàng loạt và chế độ “God Mode” nâng cao để đánh giá bảo mật toàn diện, sử dụng các kỹ thuật như chèn tải trọng (payload injections) và tấn công định dạng phản hồi.

- Công cụ này hỗ trợ nhiều mô hình AI, chẳng hạn như Gemini 2.0, Grok 3, Grok 4 và GPT OSS 120B, đồng thời cung cấp thông tin chi tiết về các mức độ bảo mật khác nhau của chúng.

- Nó tạo ra các vector tấn công mới, bao gồm tải trọng dựa trên chuỗi (string-based payloads) và dựa trên mã (code-based payloads), để kiểm tra khả năng xử lý ngôn ngữ tự nhiên và lệnh thực thi của các mô hình AI.

- Các cải tiến được lên kế hoạch bao gồm khả năng tự động nghiên cứu, chuỗi tấn công đa bước và phân tích thực thi, nhằm mục đích thích ứng với các mối đe dọa trong thế giới thực và cải thiện hơn nữa việc kiểm tra an toàn AI.

Cách công cụ AI Redteam hoạt động

Công cụ AI Redteam được thiết kế để kiểm tra bảo mật của các mô hình AI bằng cách sử dụng mã nguồn mở đã sửa đổi. Nó tích hợp với OpenRouter, cho phép bạn truy cập và đánh giá nhiều mô hình AI thông qua một giao diện thống nhất. Khả năng tương thích này mở rộng đến các mô hình được sử dụng rộng rãi như Gemini 2.0, Grok 3, Grok 4 và GPT OSS 120B. Kiến trúc mô-đun của nó đảm bảo tính linh hoạt, cho phép bạn thực hiện mọi thứ từ đánh giá lỗ hổng cơ bản đến mô phỏng tấn công nâng cao.

Thiết kế của công cụ nhấn mạnh khả năng thích ứng. Dù bạn là nhà nghiên cứu, nhà phát triển hay chuyên gia bảo mật, nó cung cấp một nền tảng để khám phá điểm mạnh và điểm yếu của các hệ thống AI. Bằng cách tập trung quyền truy cập vào nhiều mô hình, nó đơn giản hóa quá trình kiểm tra và so sánh các biện pháp phòng thủ của chúng, biến nó thành một tài nguyên quý giá để nâng cao bảo mật AI.

Các tính năng chính: Kiểm tra và mô phỏng tấn công

Công cụ này cung cấp một loạt các tính năng được điều chỉnh để đáp ứng các yêu cầu kiểm tra đa dạng. Các tính năng này được thiết kế để phát hiện lỗ hổng và cung cấp thông tin chi tiết có thể hành động để cải thiện các biện pháp phòng thủ AI:

- Kiểm tra một mô hình: Tập trung vào việc đánh giá bảo mật của một mô hình AI cụ thể để xác định các lỗ hổng riêng của nó.

- Kiểm tra hàng loạt: Kiểm tra nhiều mô hình cùng lúc để phát hiện các mẫu điểm yếu trên các hệ thống khác nhau.

- Chế độ God Mode: Đối với người dùng nâng cao, chế độ này kết hợp nhiều kỹ thuật tấn công, cung cấp đánh giá toàn diện về các biện pháp phòng thủ của một mô hình.

Công cụ này sử dụng các phương pháp tấn công được xác định trước như tấn công định dạng phản hồi, chèn tải trọng (payload injections) và các nỗ lực vượt qua. Các kỹ thuật này khai thác các điểm yếu chung, bao gồm xác thực đầu vào kém và các biện pháp bảo vệ ngữ cảnh không đầy đủ. Ví dụ, tấn công định dạng phản hồi thao túng cấu trúc đầu ra của AI, trong khi chèn tải trọng (payload injections) đưa các đầu vào độc hại vào để kiểm tra khả năng phục hồi của hệ thống. Bằng cách mô phỏng các kịch bản này, công cụ cung cấp sự hiểu biết sâu sắc hơn về cách các mô hình AI phản ứng với các mối đe dọa tiềm tàng.

Cách tin tặc khai thác các hệ thống AI như Gemini 2.0 và Grok 4

Tiết lộ lỗ hổng mô hình

Thử nghiệm được thực hiện trên các mô hình như Gemini 2.0 và Grok 4 đã tiết lộ các mức độ lỗ hổng khác nhau. Một số mô hình, chẳng hạn như GPT OSS 120B, đã thể hiện khả năng phòng thủ mạnh mẽ trong các kịch bản cụ thể, cho thấy khả năng xử lý hiệu quả một số loại tấn công nhất định. Tuy nhiên, các mô hình khác, như Grok 3, lại gặp khó khăn với các tải trọng phức tạp hơn, làm nổi bật những lỗ hổng đáng kể trong bảo mật của chúng.

Những phát hiện này nhấn mạnh tầm quan trọng của việc cải tiến liên tục về an toàn AI. Ngay cả những mô hình tiên tiến nhất cũng có thể bộc lộ điểm yếu, đặc biệt khi đối mặt với các phương pháp tấn công mới hoặc tinh vi. Bằng cách xác định các lỗ hổng này, công cụ cung cấp nền tảng để phát triển các hệ thống AI an toàn hơn.

Tạo tải trọng và vector tấn công mới

Một trong những tính năng nổi bật của công cụ là khả năng tạo ra các vector tấn công mới. Sử dụng các mô hình tiên tiến như GPT-5, nó tạo ra cả tải trọng dựa trên chuỗi (string-based payloads) và dựa trên mã (code-based payloads) được thiết kế để khai thác các lỗ hổng cụ thể. Các tải trọng này được tùy chỉnh để kiểm tra các khía cạnh khác nhau của chức năng một mô hình AI:

- Tải trọng dựa trên chuỗi: Nhắm mục tiêu vào khả năng xử lý ngôn ngữ tự nhiên của mô hình, kiểm tra khả năng diễn giải và phản hồi các đầu vào phức tạp.

- Tải trọng dựa trên mã: Đánh giá mức độ xử lý các lệnh thực thi của mô hình, xác định các điểm yếu tiềm ẩn trong logic xử lý của nó.

Khả năng này nâng cao độ chính xác của việc kiểm tra và cung cấp thông tin chi tiết về các mối đe dọa tiềm tàng trong thế giới thực. Bằng cách mô phỏng các kịch bản tấn công đa dạng, công cụ trang bị cho các nhà nghiên cứu và nhà phát triển kiến thức cần thiết để tăng cường các biện pháp phòng thủ AI.

Hợp lý hóa kiểm tra với xử lý hàng loạt

Xử lý hàng loạt là một tính năng quan trọng khác của công cụ, cho phép bạn đánh giá nhiều mô hình bằng cách sử dụng cùng một tải trọng. Cách tiếp cận này không chỉ tiết kiệm thời gian mà còn cho phép phân tích toàn diện hơn về các lỗ hổng trên các hệ thống khác nhau. Bằng cách so sánh kết quả, bạn có thể xác định các mẫu điểm yếu và hiểu rõ hơn về cách các mô hình khác nhau phản ứng với các mối đe dọa tương tự.

Tính năng này đặc biệt hữu ích cho các tổ chức quản lý nhiều hệ thống AI. Nó đơn giản hóa quá trình đánh giá bảo mật của chúng và cung cấp cơ sở để thực hiện các cải tiến có mục tiêu. Bằng cách hợp lý hóa việc kiểm tra, công cụ giúp đảm bảo rằng các mô hình AI được trang bị tốt hơn để xử lý các cuộc tấn công tiềm tàng.

Các cải tiến được lên kế hoạch: Thích ứng với các mối đe dọa trong thế giới thực

Các nhà phát triển công cụ AI Redteam đang tích cực nghiên cứu các cải tiến để làm cho nó hiệu quả hơn nữa. Các tính năng được lên kế hoạch này nhằm mục đích tái tạo bản chất thích ứng của các mối đe dọa trong thế giới thực, cung cấp một nền tảng toàn diện hơn để kiểm tra bảo mật AI:

- Khả năng tự động nghiên cứu: Tự động tinh chỉnh các chiến lược tấn công bằng cách lặp lại việc tạo và kiểm tra tải trọng.

- Chuỗi tấn công đa bước: Mô phỏng các kịch bản phức tạp trong đó nhiều lỗ hổng được khai thác theo trình tự.

- Duyệt thư viện: Đơn giản hóa việc truy cập vào kho lưu trữ các kỹ thuật tấn công, giúp dễ dàng khám phá và áp dụng các phương pháp khác nhau.

- Phân tích thực thi: Đánh giá hiệu quả của các phương pháp tấn công khác nhau, cung cấp thông tin chi tiết về tác động của chúng đối với các mô hình AI.

Những cải tiến này được thiết kế để giải quyết bản chất đang phát triển của các mối đe dọa AI, đảm bảo rằng công cụ vẫn là một tài nguyên quý giá cho các nhà nghiên cứu và nhà phát triển.

Thách thức và hạn chế hiện tại

Mặc dù có tiềm năng, công cụ này phải đối mặt với một số thách thức giới hạn khả năng sử dụng hiện tại của nó. Lỗi và các tính năng chưa hoàn thiện có thể cản trở hiệu quả của nó, đặc biệt khi kiểm tra các kịch bản phức tạp hơn. Ngoài ra, một số mô hình thể hiện các biện pháp bảo vệ mạnh mẽ hơn trong môi trường trình duyệt so với kiểm tra API, tạo ra sự không nhất quán trong hiệu suất bảo mật của chúng.

Những hạn chế này nhấn mạnh sự cần thiết của các biện pháp bảo mật đồng nhất hơn trên các ngữ cảnh triển khai khác nhau. Giải quyết những thách thức này sẽ rất quan trọng để đảm bảo sự thành công lâu dài và hiệu quả của công cụ trong việc nâng cao an toàn AI.

Thúc đẩy hợp tác trong bảo mật AI

Các nhà phát triển nhấn mạnh tầm quan trọng của sự hợp tác trong việc cải thiện bảo mật AI. Bằng cách chia sẻ công cụ của họ và khuyến khích sự đóng góp từ cộng đồng rộng lớn hơn, họ hướng tới việc thúc đẩy nỗ lực chung để giải quyết các lỗ hổng của hệ thống AI. Thử nghiệm có trách nhiệm là chìa khóa để hiểu rõ những điểm yếu này và phát triển các biện pháp phòng thủ hiệu quả.

Sự tham gia của bạn vào nỗ lực này có thể đóng một vai trò quan trọng trong việc định hình tương lai của an toàn AI. Bằng cách tích cực tham gia vào việc kiểm tra và tinh chỉnh, bạn có thể giúp đảm bảo rằng các hệ thống AI vẫn an toàn, đáng tin cậy và có khả năng đáp ứng các thách thức của một thế giới ngày càng kết nối.